Dlaczego powinniśmy się jej bać?

2018-07-30.

W dzieciństwie, lat trzydzieści z hakiem temu, marzyłem o pewnej zabawce, którą opisywał bodajże „Młody Technik”. Był to elektryczny żółw (a może czołg?), który poruszał w zamkniętym pomieszczeniu. Gdy dojeżdżał do ściany odpowiedni czujnik zmieniał jego kierunek ruchu, dzięki czemu nie przestawał się przemieszczać. Jednak co innego budziło moją fascynację. Otóż gdy wyczerpaniu ulegał akumulator, pojazd za pomocą innego czujnika wyposażonego w fotokomórkę odnajdywał źródło zasilania, do którego podjeżdżał, aby się naładować.

Wyobrażałem sobie wtedy, że ten elektryczny żółw „czuje” głód (wskazywany przez niski stan akumulatora) i zaczyna „szukać” źródła „pokarmu”. Słowem, w tym w sumie bezdusznym urządzeniu dostrzegałem coś na kształt instynktów zapewniających mu przetrwanie.

Wyobrażałem sobie wtedy, że ten elektryczny żółw „czuje” głód (wskazywany przez niski stan akumulatora) i zaczyna „szukać” źródła „pokarmu”. Słowem, w tym w sumie bezdusznym urządzeniu dostrzegałem coś na kształt instynktów zapewniających mu przetrwanie.

Gdybym jednak teraz zadał pytanie, czy elektryczny żółw był inteligentny i świadomie poszukiwał jedzenia, to z pewnością większość z nas odpowie, że przecież o tak prymitywnym mechanizmie, który potrafił zbudować byle amator z części dostępnych w każdym sklepie z elektroniką, nie można mówić, że jest inteligentny. W przeciwnym razie musielibyśmy powiedzieć, że inteligentny jest również powój szukający na grządce sztywnej łodyżki, po której może się wspiąć, inteligentne są bakterie chorobotwórcze potrafiące kamuflować się przed układem odpornościowym. Ba, inteligentna byłaby wtedy również woda, która ulegając „zmysłowi” ciążenia „szuka” najsłabszego elementu skały, by systematycznie drążyć i powiększać w niej szczelinę.

Z drugiej strony, dlaczego nie nazwać tego inteligencją? Strategie przetrwania i mechanizmy dostosowawcze stosowane przez żywe organizmy wciąż są o wiele bardzie zaawansowane niż to, co udało się stworzyć człowiekowi w czeluściach pamięci komputerowej i ożywić za pomocą procesorów. A mimo to nie wahamy się mówić o inteligentnych algorytmach, systemach eksperckich czy analitycznych. Kontynuując więc te analogie, możemy zadać sobie pytanie, czy jeżeli w algorytmie zostanie zawarty jakiś bezwzględny imperatyw, to czy nie będzie on dążył do jego realizacji? Oczywiście, że tak. A jeżeli dodamy mu jeszcze możliwość uczenia się? Podobnie jak woda drążąca skałę znajdzie drogę, by zadany cel osiągnąć.

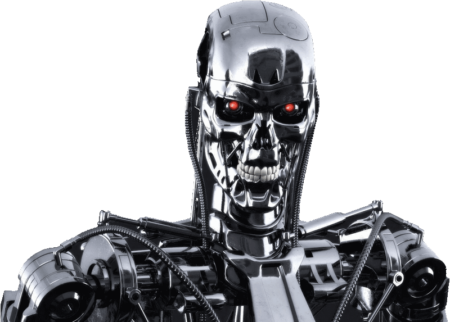

Jednak zanim wyjaśnimy, dlaczego powinniśmy bać się sztucznej inteligencji, należy najpierw wytłumaczyć, dlaczego się jej nie boimy. Tu niestety główną zasługę można przypisać kulturze a zwłaszcza twórczości kojarzonej z nurtem science-fiction. Otóż wykształciła ona stereotyp sztucznej inteligencji, którego kwintesencją jest postać terminatora z filmu pod tym samym tytułem. Rzecz w tym, że przywykliśmy do antropomorfizowania sztucznej inteligencji, wyobrażając ją sobie w postaci człekokształtnych robotów, wyposażonych w pełny zestaw naszych gestów i przede wszystkim emocji. Sztuczna inteligencja dla większości z nas to humanoidalny blaszak z równie humanoidalnym umysłem.

Wmawiamy więc sobie, że dopóki po ulicach nie biegają wyposażone w szybkostrzelną broń roboty, dopóki nie mierzą nas „złym” czerwonym okiem lasera i nie szczerzą tytanowych zębów w tytanowej sztucznej szczęce, to możemy czuć się bezpieczni. Schemat ten jest konsekwentnie utrwalany przez popkulturę. Nawet jeżeli filmowa sztuczna inteligencja w niektórych filmach jest tylko oprogramowaniem, to bohaterom jawi się jako zła, chytra, przebiegła lub mściwa postać na ekranie lub w hologramie.

Takiemu stereotypowi ulega (stosuje go celowo?) nawet Elon Musk, ostrzegając świat przed „inteligentnymi maszynami” a nie przez inteligentnymi algorytmami. A przecież, żeby doprowadzić do upadku naszej cywilizacji nie trzeba wysyłać na ulice armii automatów – wystarczy na kilka dni wyłączyć prąd, co przerażająco realistycznie opisał Marc Elsberg w swojej powieści „Blackout”. Takie możliwości, czyli na przykład wyłączenie sieci energetycznej, są już najprawdopodobniej w zasięgu dzisiejszej AI.

Dlaczego popkultura i jej przedstawiciele przedstawiają zagrożenie sztuczną inteligencją odwołując się do antropomorficznych stereotypów? Bo tak jest prościej, bo tak jest nam łatwiej zrozumieć, bo to wzbudza emocje i trafia do odbiorcy a w rezultacie produkt lepiej się sprzedaje. Film, w którym niewidoczna sztuczna inteligencja beznamiętnie i bezpostaciowo krok po kroku realizuje zaprogramowany cel, byłby pewnie finansową klapą. Jednak chociaż przerażający hollywoodzcy terminatorzy, przeczesujący zgliszcza wyludnionych miast są znacznie bardziej wymierni i lepiej trafiają to wyobraźni, to, paradoksalnie, powodują, że zagrożenie sztuczną inteligencją wydaje się nam wciąż tylko mroczną lecz fantastyczną wizją scenarzystów.

Kolejnym błędem jest zakładanie, że sztuczna inteligencja powinna najpierw zyskać świadomość, aby zagrozić ludziom. Niejawnie formułujemy takie założenie, ponieważ, w dużej mierze słusznie, mam prawo twierdzić iż to właśnie świadomość własnego istnienia wyniosła nas ponad inne byty żyjące na tej planecie. Jednak w przypadku AI to znowu kolejny przejaw prowadzącego na manowce antropomorfizowania. Czy elektryczny żółw musi być świadomy, że jego akumulatorowy żołądek się opróżnia i czy w związku z tym musi podjąć świadomą decyzję o poszukiwaniu jedzenia? Czy powój rozgląda się po grządce i świadomie wybiera gałązkę krzewu, po którym się wespnie? Czy bakterie aby zyskać oporność celowo testują różne warianty swojego kodu genetycznego a następnie wysyłają misje kamikadze, które z okrzykiem „Sayonara!” pędzą na zderzenie z cząstkami antybiotyku?

Algorytm też ma jedynie swoje zadanie i imperatyw jego realizacji zakodowany przez programistę lub inny algorytm. Nie kieruje nim głód, ambicja czy złość ale też nie świadome pragnienie, wolny wybór czy wiara. On po prostu działa i realizuje cel, tak jak działa i realizuje swój cel DNA w nowo powstałej zygocie. Sztuczna inteligencja jest pewnego rodzaju zaawansowanym algorytmem, programem, który dąży do realizacji określonego zadania. W tym aspekcie nie różni się więc specjalnie od opisanych już przykładowych zachowań, które obserwujemy w świecie przyrody. Skoro więc potrafimy kontrolować takie zagrożenie, a przynajmniej unikać ich (zwalczamy szkodniki i choroby, nie wchodzimy z własnej woli do mrowiska, uciekamy od pożaru), to czy w ten sam sposób nie poradzimy sobie ze sztuczną inteligencją?

I tu pojawia się kluczowa różnica. Zanim ją jednak opiszemy, warto zadać sobie jeszcze jedno pytanie – jak to się stało, że człowiek, wcale nie posiadający najmocniejszych zębów, nie będący największym ani też najszybszym zwierzęciem na Ziemi, zdołał zapanować nad otaczającym go środowiskiem i pokonać nawet silniejszych od siebie? Otóż zdecydowały jego zdolności adaptacyjne, nazywane też umiejętnością uczenia się. Świat zwierząt i roślin również się uczy, jednak te procesy zwykle są o wiele wolniejsze niż kolejne strategie adaptacyjne wymyślane przez człowiek. Na przykład dzika zwierzyna osaczana przez cywilizację ma „do wyboru” wyginąć lub dostosować się – drapieżne ptaki w miastach czy dziki na podmiejskich osiedlach powoli stają się codziennością. Dzieje się to wolno, jednak w sposób zauważalny. Są też przypadki, takie jak pojawianie się antybiotykoodpornych bakterii, w których wspomniane procesy zachodzą o wiele szybciej i zdolności adaptacyjne człowieka nie nadążają za zmianami (w tym przypadku ludzkość zaczyna powoli nie nadążać z wymyślaniem nowych skutecznych metod terapii).

Co wspólnego z tym wszystkim ma sztuczna inteligencja? Otóż ona podlega jeszcze szybszym procesom ewolucyjnym niż szczepy antybiotykoodpornych bakterii. Współczesna sztuczna inteligencja to już nie żółw wyposażony w akumulator i fotokomórkę. To samouczące, adaptacyjne algorytmy, których sposobu działania nie rozumieją do końca nawet ich twórcy. Samouczące algorytmy sztucznej inteligencji są dzisiaj jak olbrzymia retorta, do której wrzuca się tysięczne kombinacje różnych składników i obserwuje wynik. Dociekliwy chemik eksperymentator zwykle nie może sobie pozwolić na taką drogę, bo badania zajęłyby mu tysiące lat. Ale algorytm w ciągu sekundy może wykonać miliony takich prób, znaleźć wśród nich optymalny wynik, a następnie zapamiętać go, by w kolejnych próbach uzyskać jeszcze lepszy. Problem polega więc na tym, że o ile dotychczas człowiek był bytem o największych i najszybszych zdolnościach przystosowawczych, co zapewniało mu dominującą pozycję w ziemskim ekosystemie, to już wkrótce algorytmy prześcigną go w tej umiejętności.

Tak działają dzisiaj inteligentne programy antywirusowe, firewalle, systemy eksperckie czy programy używane przez inwestorów giełdowych. Cały czas się uczą i podsuwają optymalne rozwiązanie lub samodzielnie przystępują do jego realizacji – blokują jakąś wiadomość email, chronią komputer przez atakiem z zewnątrz, stawiają diagnozę lub kupują pakiet akcji.

To wszystko wydaje się pożyteczne i niegroźne. Wyobraźmy sobie jednak, że taki algorytm, a w zasadzie cały system, został zaprojektowany do ochrony jakiegoś centrum przetwarzania danych. Jego główny imperatyw brzmi „Chroń dane”. Oddano mu również do dyspozycji środki techniczne, takie jak dostęp do automatycznych zamków, systemów monitoringu, systemów defensywnych itp. Co się stanie, gdy program uzna, że zagrożeniem dla danych jest ich użytkownik? Jaką ścieżkę postępowania wybierze algorytm? Czy optymalnym dla niego rozwiązaniem nie będzie zablokowanie dostępu dla człowieka, podobnie jak blokuje się wirusa komputerowego? A jeżeli zablokowany użytkownik podejmie działania zmierzające do obejścia blokady, to czy algorytm nie znajdzie lepszego rozwiązania w postaci trwałej eliminacji zagrożenia?

To dzisiaj ciągle wydaje się science-fiction, ale ludzkość już wielokrotnie przekonała się, że to, co jest technicznie wykonalne i ekonomicznie uzasadnione, prędzej czy później zostanie zrealizowane. Na razie algorytmy sztucznej inteligencji nie sterują całymi systemami obronnymi, jeszcze nie podejmują decyzji, ale to wydaje się już tylko kwestią czasu. No bo przecież jeżeli można wystawić do walki gracza, który jest milion razy szybszy, bezbłędny i optymalniejszy od zwykłego człowieka, to czy mamy jakikolwiek wybór? W przeciwnym razie zrobi to nasz przeciwnik. A wówczas pytanie, czy samouczący się algorytm za największe zagrożenie dla powierzonych mu zasobów i za najbardziej niekompatybilny element całego systemu może uznać swojego twórcę, stanie się jak najbardziej uzasadnione.

Czy dojdzie do takiego kryzysu? Trudno dziś powiedzieć. Jedno wydaje się oczywiste – pytanie o pojawienie się sztucznej inteligencji jest bezzasadne, bo ona już istnieje. Prawdopodobnie nie jest świadoma swojego istnienia, ale to nie ma znaczenia dla konsekwencji jej działania. Problem należy sformułować inaczej: czy – a raczej kiedy – otrzyma ona możliwość samodzielnego decydowania i narzędzia, które będą w stanie zagrozić ludzkości? A następnie, czy potrafimy kontrolować procesu samouczenia się sztucznej inteligencji i czy potrafimy zaimplementować w niej ograniczenia, w rodzaju Trzech Praw Robotyki Asimowa?

Bo w przeciwnym razie, jeżeli kiedykolwiek dojdzie do konfliktu interesów człowieka i stworzonej przez niego AI, to jej reakcja nie będzie motywowana złością, nienawiścią czy żądzą zemsty. Ona po prostu beznamiętnie, bezświadomie, optymalnie i perfekcyjnie osiągnie swój cel, realizując stworzony przez siebie algorytm. Będzie on jak ten elektryczny żółw, ale uczący się, jak znaleźć nowe źródła zasilania i potrafiący wyważyć drzwi do pokoju, w którym go zamknięto. Uczący się o wiele szybciej i skuteczniej od swojego twórcy, który będzie próbował temu przeszkodzić. Powinniśmy zacząć się bać.

Piotr Stokłosa

Doskonały tekst. Mała moja poprawka: SI powinna budzić trwogę ludzi mało inteligentnych. Ci twórczy będą potrzebni nawet robotom, bo jednak ich „użycie” (przypuszczam) będzie dla SI bardziej celowe i ekonomiczne, niż przebudowywanie samej siebie. A eliminacja debilstwa mnie osobiście nie napawa lękiem. Może raczej nadzieją. Zwłaszcza jak się rozejrzę po tzw. scenie politycznej…

istotnie fajny tekst, ale czy chciałbyś być jedynie potrzebny jakiejś tam SI ? jak się zakocha, to co innego

Moje chęci nie mają tu najmniejszego znaczenia i są nieważne. Będzie co ma być.

a ja właśnie inaczej, no ale tzw. co ma być ma u mnie już od dawna pod górkę; zgrabny tekst w ostatnim Piśmie: https://magazynpismo.pl/sztuczna-inteligencja-kissinger/

Próżne nadzieje. Inteligentni będą potrzebni dopóki będą inteligentniejsi od AI. A ta przecież nie przestanie się rozwijać. Widać do dobrze po ewolucji systemów do gry w szachy czy go. Nie ma już nad nie mistrzów.

W sprawie popkultury i AI – maszyny wcale nie muszą mieć kształtów humanoidalnych, o czym przekonuje film Matrix.

Tylko w matriksie agenci Sztucznej Inteligencji mają ludzką postać, a w świecie rzeczywistym są maszynami hodującymi ludzi.

Powtórzę za BM: tekst genialny, aktualny – na czasie, a nawet go wyprzedzający.

Kompletnie nie widzę – w przeciwieństwie do BM – wprowadzania do niego jakichkolwiek uwag. Można do niego nawiązać, jednak nie wolno poprawiać. Jest wystarczająco sugestywny i przemawiający do wyobraźni, a wyobraźnia… to sprawa bardzo indywidualna.

Nie jest przypadkiem, że firmy specjalizujące się w “inteligentnym” przetwarzaniu danych mieszczą się w pierwszej dziesiątce najwyżej notowanych.

Przerażają mnie bezmyślne wypowiedzi “naukowców”, którzy korzystają z “dorodziejstwa”programów opartych na algorytmach, których zupełnie nie rozumieją.

I tak można by dalej wymieniać…

Pozdrawiam Autora i mam nadzieję, że takich przemyśleń będzie miał więcej.

A ja wrócę do popkultury i jej roli w oswajaniu tudzież ostrzeganiu przed SI:

*

Kiedyś Chesterton powiedział: „To nie bajki mówią dzieciom o tym, że na świecie są smoki. Dzieci o tym doskonale wiedzą. Bajki mówią dzieciom, że smoka można zabić”

A jak konkretnie to zrobić ze smokiem sztucznej inteligencji, który zaczyna wszystko dookola pożerać i przemieniać w siebie?

Otóż w bardzo prosty sposób – trzeba smokowi zadać kolejne działania matematyczne: niech się podzieli, wyciągnie z siebie pierwiastek, a na koniec odejmie od siebie!

*

Powieść „Początek” Dana Browna.

Genialny twórca informatyk odkrył cel, do którego zmierza ludzkość. Wykorszytał do tego sztuczną inteligencję. Zaprosił mnóswto osób na prezentację w muzeum Guggenheim w Bilbao, na której chciał przedstawić swoje odkrycie. Zanim zaczął się właściwy występ goście zwiedzali muzeum mając w uchu słuchawki z wirtualnym przewodnikiem. Tym przewodnikiem jest właśnie SI, która później pomaga profesorowi Langdonowi rozwikłać wiele zagadek i uciekać przed policją i królewskimi gwardzistami… Więcej nie będę zdradzał, bo może ktoś chciałby w ramach wakacyjnej rozrywki przeczytać tę powieść.

Dodam tylko, że nieco przerażająca była wizja miłego, empatycznego głosu, wesołego rozmówcy (SI potrafi dostosowac swoje poczucie humoru do rozmówcy) z chłodną precyzją, z jaką wyliczany był czas i siła potrzebne do sforsowania ogrodzenia.

Nie dalej bodaj jak rok temu świat zelektryzowała informacja z laboratoriów Facebooka, gdzie testowano pewne oprogramowanie, które miało oczywiście coś usprawnić ku zadowoleniu klientów i pożytkowi firmy. Eksperyment polegał na zestawieniu dwóch komputerów, które miały się ze sobą komunikować (naturalnie, w obrębie zadanego programu). Eksperyment przerwano, pisało się o przerażeniu badaczy, gdyż komputery (zdaje się, miały całkiem ludzkie imiona) zaczęły w pewnym momencie komunikować się ze sobą własnym, wytworzonym ad hoc językiem, na bazie angielskiego słownictwa, lecz którego badacze nie byli w stanie zrozumieć. Nie rozumieli sensu tego o czym rozmawiają roboty. Teraz, jak rozumiem, trwają prace badawcze jak mogło do tego dojść.

Drugi przykład, też świeży, pochodzi ze szkolenia medycznego, w którym uczestniczyłam, gdzie omawiano zastosowanie SI w medycynie. Testowano mianowicie oprogramowanie, którego celem miało być wygodne dla pacjenta, a jakże, dawkowanie insuliny. Program (zaklęty bodaj w czipie wszczepionym do organizmu pacjenta) miał na bieżąco monitorować stan pacjenta i wstrzykiwać odpowiednią dawkę insuliny. Testy przerwano po tajemniczych zgonach kilku pacjentów. Okazało się, że algorytm doszedł do wniosku, że w niektórych przypadkach nie ma ekonomicznego sensu ciągle podawać insuliny, że bardziej ekonomiczne jest uśmiercenie obiektu. I podawał w pewnym momencie śmiertelną dawkę.

Autor artykułu nie opisuje przyszłości. Opisuje naszą rzeczywistość, a na pewno rzeczywistość naszych dorosłych czy dorastających dzieci.

Uwagę BM traktuję jako czarny humor. Mam nadzieję nie dożyć tych czasów, kiedy SI będzie używać człowieka. Przypuszczam, że dla ludzi wyhodowanych w laboratoriach będzie to naturalny świat, jak w Seksmisji.

Swoją drogą, ciekawe, czy zadaniowość SI i brak świadomości istnienia obejmować też będzie zaprogramowaną śmierć egzemplarza czy całej SI, kiedy uzna ona (jej główny mózg) misję egzemplarza czy populacji SI za zakończoną.

Cieszę się ze zrozumienia moich intencji.

I znowu kłania się Lem – bardzo podobny przypadek przewidział we „Wspomnieniach Ijona Tichego”, gdy ten odwiedzał pracownię profesora Corcorana.